自分の声だけに基づいて、見たことのない人の心のイメージを構築したことがありますか?人工知能(AI)がこれを実行できるようになり、参照用の短いオーディオクリップのみを使用して人物の顔のデジタル画像が生成されます。

Speech2Faceという名前のニューラルネットワーク-人間の脳と同じように「思考」するコンピューター-は、10万人以上の異なる人々が話していることを示すインターネットからの何百万もの教育用ビデオで科学者によって訓練されました。

このデータセットから、Speech2Faceは声の合図と人間の顔の特定の身体的特徴との関連を学習したと研究者らは新しい研究で書いています。次に、AIは音声クリップを使用して、声と一致する写実的な顔をモデル化しました。

調査結果は、5月23日のプレプリントジャーナルarXivでオンラインで公開され、ピアレビューされていません。

ありがたいことに、AIは特定の個人が自分の声だけでどのように見えるかを(まだ)正確に認識していません。研究者らは、ニューラルネットワークは、性別、年齢、民族性、多くの人が共有する特徴を示す音声の特定のマーカーを認識したと報告しています。

「このように、モデルは平均的に見える顔を作るだけです」と科学者たちは書いています。 「特定の個人の画像は生成されません。」

AIは猫の解釈が率直に言って恐ろしいものですが、それは正確に人間の顔を生成できることをすでに示しています。

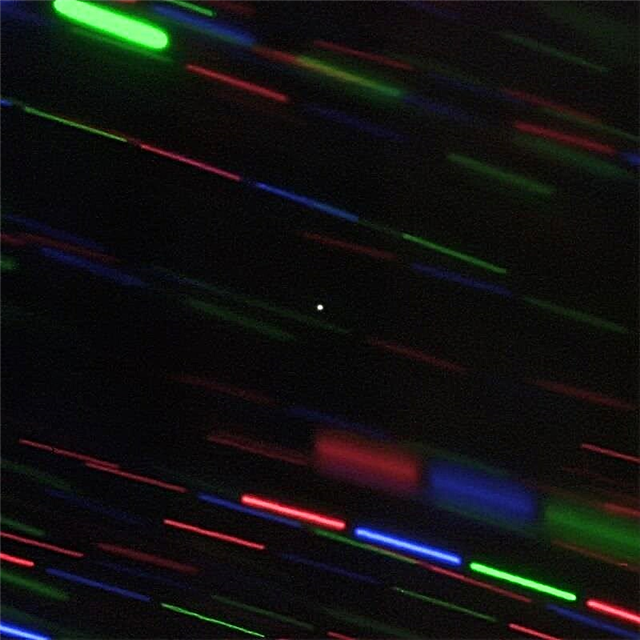

Speech2Faceによって生成された顔は、すべて正面を向いていて、ニュートラルな表情をしていますが、声の後ろにいる人と正確には一致していませんでした。しかし、研究によると、画像は通常、個人の正しい年齢範囲、民族、性別を捉えていました。

ただし、アルゴリズムの解釈は完全とはほど遠いものでした。 Speech2Faceは、言語のバリエーションに直面したときに「混合パフォーマンス」を示しました。たとえば、AIが中国語を話すアジア人のオーディオクリップを聞くと、プログラムはアジア人の顔の画像を生成しました。しかし、同じ男性が別のオーディオクリップで英語を話すと、AIが白人男性の顔を生成したと科学者たちは報告しています。

このアルゴリズムは、性差バイアスも示し、低音の声を男性の顔に関連付け、高音の声を女性の顔に関連付けました。また、トレーニングデータセットはYouTubeの教育用動画のみを表すため、「世界の人口全体を表すものではない」と研究者たちは書いている。

このビデオデータセットに関するもう1つの懸念は、YouTubeビデオに出演した人物がその肖像画が調査に組み込まれたことを知って驚いたときに生じた、とスレートは報告した。サンフランシスコのインターネットセキュリティ会社Cloudflareの暗号化責任者であるNick Sullivanは、Speech2Faceのトレーニングに使用された例の1つとして彼の顔を予期せず発見しました(アルゴリズムはかなり近似的に再現されていました)。

Slate氏によると、サリバン氏は調査への参加に同意していませんでしたが、このデータセット内のYouTube動画は、研究者が追加の権限を取得することなく使用できると広く考えられています。